Créer des Applications avec les Modèles de Langage (LLM) : Introduction et Concepts Clés

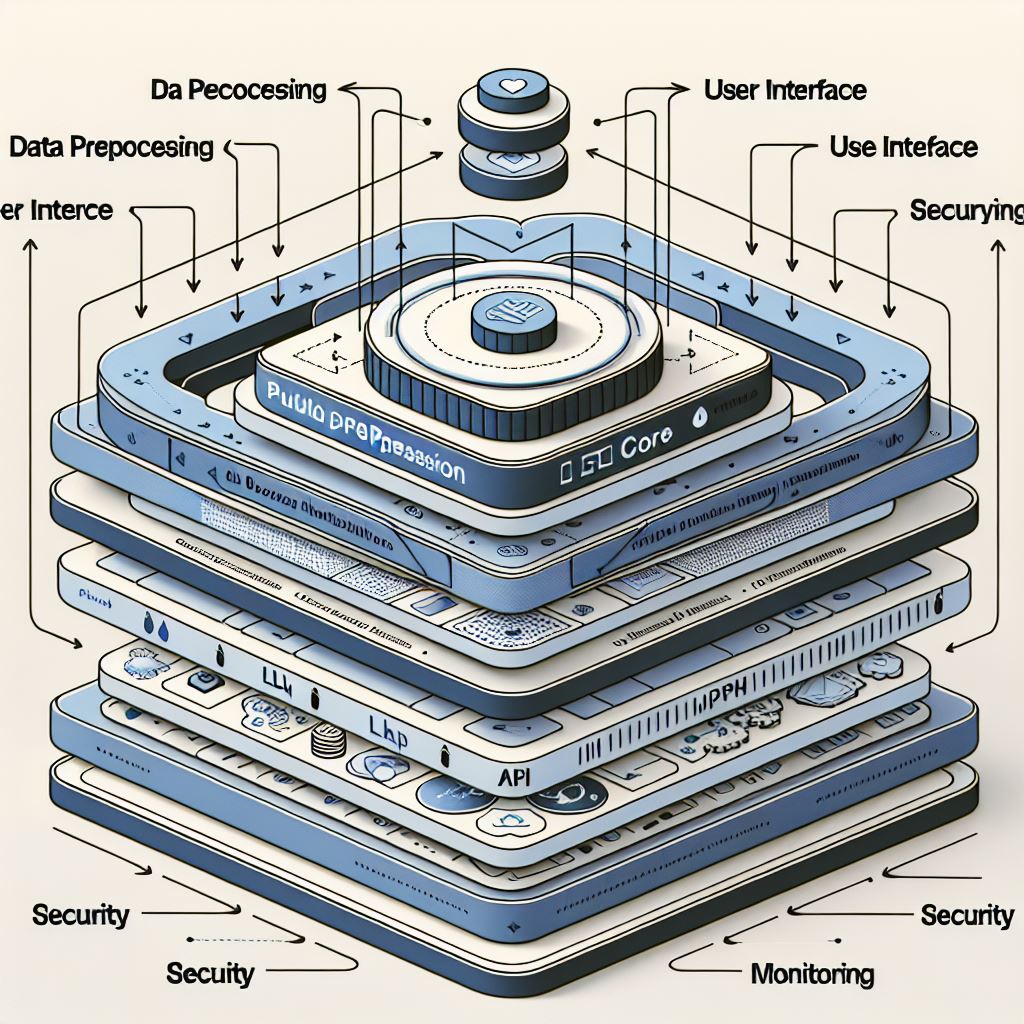

Les grands modèles de langage (LLM) sont conçus pour fonctionner dans un contexte général où les utilisateurs peuvent poser des questions et recevoir des réponses. Cependant, pour créer une application LLM dans des scénarios réels, les couches au-delà du modèle jouent un rôle crucial. Une application LLM nécessite plusieurs modules pour fonctionner de manière fluide, notamment :

- Modules utilisateur (UI) : Interfaces pour interagir avec les utilisateurs.

- Modules de données (bases de données) : Pour stocker et gérer les informations.

- Modules LLM (modèles et pipelines) : Où le modèle est intégré et utilisé.

- Modules de performance (gestion des files d'attente) : Pour optimiser les performances.

Pour simplifier ce processus complexe, les développeurs ont besoin d'un cadre abstrait. Les nouveaux frameworks LLM évoluent rapidement et permettent une intégration rapide et fluide des modules d'application.

Explorerons deux frameworks populaires :

- LangChain : Renommé pour ses fonctionnalités étendues, adapté aux applications de chat complexes en entreprise.

- LlamaIndex : Spécialisé dans la recherche et l'amélioration des performances des applications RAG (Retrieval-Augmented Generation).

Objectifs d'Apprentissage

À la fin de ce chapitre, vous serez capable de :

- Comprendre les différents modules de LangChain avec des exemples pratiques.

- Appliquer la technique RAG (Retrieval-Augmented Generation) pour améliorer la pertinence des réponses des LLM dans des cas d'utilisation spécifiques.

- Construire des prototypes simples en utilisant LangChain et LlamaIndex.

Introduction à LangChain

Qu'est-ce que LangChain ?

LangChain est un framework open source disponible en bibliothèques Python et Java. Il fournit des outils, des frameworks et des intégrations interchangeables pour automatiser et simplifier le développement d'applications basées sur des LLM et la création de pipelines de génération de texte.

Les principales fonctionnalités de LangChain incluent :

- Importation de modèles LLM.

- Chaînes (chains) pour organiser les pipelines.

- Modèles de prompt (prompt templates) pour personnaliser les interactions.

- Gestion de la mémoire (memory) pour maintenir le contexte des conversations.

- Chargeurs de documents (document loaders) pour importer divers types de fichiers.

- Agents pour interagir avec des sources externes.

Concepts Clés de LangChain

1. Chaînes (Chains)

Une chaîne est une classe Python fournie par LangChain qui encapsule des pipelines de génération de texte réutilisables. Elle combine un modèle LLM et un modèle de prompt.

Exemple :

from langchain.llms import OpenAI

from langchain.prompts import PromptTemplate

from langchain.chains import LLMChain

llm = OpenAI(openai_api_key="votre_clé_api")

prompt = PromptTemplate(input_variables=["risque"], template="Catégorisez le risque suivant : {risque}")

chain = LLMChain(llm=llm, prompt=prompt)

result = chain({"risque": "Pas de logiciel antivirus sur mon système"})

print(result)

2. Modèles de Prompt (Prompt Templates)

Un modèle de prompt est une classe qui prend des variables d'entrée pour créer des textes dynamiques.

Exemple :

from langchain.prompts import PromptTemplate

prompt = PromptTemplate(input_variables=["langue", "tâche"], template="Donnez-moi un code {langue} pour {tâche}?")

print(prompt.format(langue="Java", tâche="addition de deux nombres"))

3. Mémoire (Memory)

La mémoire permet de stocker le contexte des interactions précédentes pour maintenir une conversation cohérente.

Exemple :

4. Chargeurs de Documents (Document Loaders)

Ces outils permettent de charger et convertir des documents dans un format compatible avec LangChain.

Exemple :

5. Vector Stores

Les bases de données vectorielles stockent des embeddings générés par les LLM pour une récupération rapide et efficace.

Exemple :

from langchain_community.vectorstores import Chroma

from langchain_community.embeddings.openai import OpenAIEmbeddings

embeddings = OpenAIEmbeddings(openai_api_key="votre_clé_api")

db = Chroma.from_documents(documents, embeddings)

results = db.similarity_search("Quel est l'impact social de la 5G?")

print(results)

Prototypes Pratiques

Prototype 1 : Discuter avec des Fichiers Excel

Objectif : Permettre à un utilisateur de télécharger un fichier Excel et de poser des questions sur son contenu.

Technologies utilisées :

- Streamlit pour l'interface utilisateur.

- Pandas pour manipuler les données.

- LangChain pour interagir avec le modèle LLM.

Prototype 2 : RAG avec LlamaIndex

Objectif : Récupérer des informations contextuelles à partir d'une base de connaissances client en utilisant la technique RAG.

Étapes :

- Charger et diviser le document en segments plus petits.

- Créer des embeddings pour chaque segment.

- Utiliser un moteur de récupération pour extraire les informations pertinentes.

Prototype 3 : Extraction de Graphes de Propriétés à partir de Journaux Médicaux

Objectif : Créer une application de chat capable d'extraire des entités et des relations à partir de journaux de recherche médicale et de générer un graphe de propriétés.

Technologies utilisées :

- Neo4j pour la gestion des graphes.

- Pyvis pour visualiser les graphes.

- LangChain pour interagir avec les modèles LLM.

Conclusion

Ce cours vous a présenté les concepts fondamentaux de LangChain et LlamaIndex, ainsi que des exemples pratiques pour construire des applications LLM. Vous êtes maintenant prêt à explorer davantage ces frameworks et à les appliquer à vos propres projets !